Hilla Körkkö käsitteli mielenkiintoisella tavalla Uuden Jutun esseessään “Keinojärki ja tunteet. Miksi tekoälystä tulee likainen olo?” likaisuuden tunnetta, joka voi seurata generatiivisen tekoälyn käytöstä työtehtävissä. Jutussa keskityttiin voittopuolisesti yksilön sisäisestä maailmasta kumpuaviin selityksiin ilmiön ymmärtämiseksi, vaikka ihmisen sosiaalinen luonne tekstin edetessä muistettiinkin tuoda esiin. Likaisuuden tunteesta puhuttiin siltikin pitkälti aivotieteen kehyksessä ja generatiiviseen tekoälyyn liittyvistä kokemuksista ylipäätään yksilöön keskittyen. Se, mitä koemme “likaiseksi” on kuitenkin ympäröivästä kulttuurista ja sosiaalisesta kontekstista kumpuavaa.

Sosiaalipsykologian näkökulmasta hyväksyttävä ja arvokas toiminta on ryhmäsidonnaista. Siihen liittyy eri kulttuurien ja alakulttuurien keskuudessa vaihtelevia normeja. Teknologian käyttö, oli se sitten tekoälyä tai jotain muuta, ei ole näiden normistojen ulkopuolelle sijoittuva ilmiö. Sille ei ole mahdollista löytää sen objektiivisempaa, sosiaalisesti “oikeaa”, moraaliarvioista vapaata ohjeistusta kuin millekään muullekaan ihmisten toiminnalle.

Arjessa käytämme luontevasti tietoa, jonka saamiseksi olisi voinut nähdä paljon enemmän vaivaa. Rakennamme jatkuvasti muiden tekemän päälle ilman, että se tuntuisi ongelmalliselta. Toimittajat luultavasti harvemmin kokevat syyllisyyttä kirjoittaessaan tutkijoiden kommentteja juttuihinsa sen sijaan, että olisivat toteuttaneet itse tutkimuksia. Kysymällä tekoälyltä reseptivinkkejä perheen ruokailua varten tuskin saamme samanlaisia tunnontuskia kuin töiden teettäminen ChatGPT:n avulla aiheuttaa, vaikka kyllä ruoan miettiminenkin vaatii aivoilta työtä ja aktivoi niitä. Harvemmin myöskään aikuisina enää koemme lunttaavamme laskinta käyttäessä, vaikka päässälasku olisi myös mahdollista. Carl Sagania siteeraten: “Jos haluaa tehdä omenapiirakan täysin alusta, ensiksi pitää keksiä universumi”. Kyse on siitä, että arvostamme joidenkin asioiden ajattelua enemmän kuin toisten. Se, milloin oma kontribuutiomme on riittävä ja tarpeeksi arvokas ja jotta voimme kokea lopputuloksesta omistajuutta, on pitkälti sosiaalinen ja normeihin liittyvä kysymys.

Jutussa nostettiin esiin selvien sääntöjen puuttuminen generatiivisen tekoälyn hyödyntämisessä. Sääntöjen käsite vie lähemmäksi tilanteen ymmärtämistä sosiaalisesta näkökulmasta. Tilanne ei kuitenkaan ole se, että meillä ei olisi sääntöjä tekoälyn käyttöön. Jo juttu itsessään vihjaa, että meillä on pikemminkin erilaisia, keskenään ristiriitaisia moraalisia sääntöjä tekoälyn käytön arvottamiseen. Kuten esseeseen haastateltu tutkija, dosentti Anna-Mari Wallenberg toteaa, on mahdollista karrikoiden erottaa vastakkaiset leirit generatiivisen tekoälyn käytön arvottamisessa. Toisessa ollaan hyvinkin innoissaan ja edistetään käyttöä. Toisessa puolestaan korostetaan järjestelmiin liittyviä ongelmia.

Esseestä saa käsityksen, että vain tekoälyn käytön vastustaminen on moralisointia. Kuitenkin tekoälyn käyttöä perustellaan hyveillä samaan tapaan kuin käyttämättömyyttä. Joka toinen näkemyksiään sosiaaliseen mediaan jakava henkilö tuntuu huutavan, että tekoälyn käyttämättä jättäminen on epärationaalista ja sen mahdollistaman tuottavuusloikan sivuuttaminen suorastaan vastuutonta: jos ette käytä oman etunne takia, niin miettikään nyt edes isänmaata ja huoltosuhdetta. Ja työnantajaanne. Suomalaisen median tulevaisuutta. Vastakkaisesta joukosta taas kerrotaan meille, että suuret kielimallit ovat varastamista, lunttaamista ja lisäksi vielä tuhoavat ympäristön samalla kun ne tyhmentävät kokonaisen sukupolven.

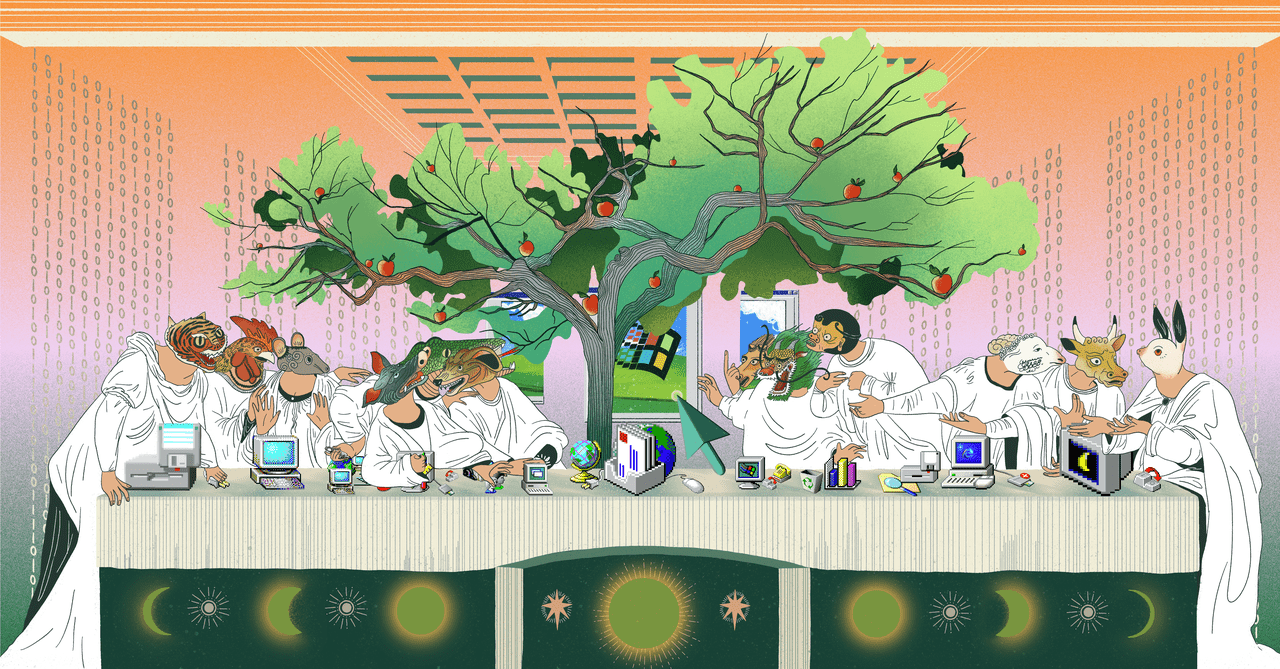

Moraaliset säännöt ovat sosiaalisia. Ne rakentuvat ihmisten välisessä vuorovaikutuksessa muodostuville jaetuille merkityksille. Tästä näkökulmasta voidaan nähdä, miten yllä mainitut eri leirit ja niiden käyttämä moralisoiva argumentaatio ohjaavat tapaamme arvottaa toimintaa, omaamme ja muiden. Asemamme tekoälyn käyttäjinä tai ei-käyttäjinä osuu näiden kahden keskenään ristiriitaisen moraalijärjestyksen väliin. Saatamme jopa huomata, että ammennamme molempien leirien argumentaatiotavoista eri tilanteissa. Nämä moraalijärjestykset edustavat kahta erilaista tapaa olla “puhdas” tai “likainen”. Tekoälyn käyttöön liittyvät tunteet taasen nivoutuvat erilaisiin sosiaalisiin ryhmiin ja niiden toisistaan poikkeaviin tapoihin arvottaa toimintaa. Suo siellä, vetelä täällä.

Työelämässä, opiskelussa ja ylipäätään vakiintuneissa hierarkisissa instituutioissa ongelman pitkällä tähtäimellä ratkaissevat valtarakenteet: jos työnantaja määrää, että tekoälyä käytetään, voi yksilö siirtää vastuuta käytöstä muualle kuin itselleen. Sama pätee ymmärrettävästi, jos palkanmaksaja, asiakas tai oppilaitos haluaa, että tätä teknologiaa ei käytetä. Arjessa puolestaan eri alakulttuurit ja ryhmät kehittänevät omat normistonsa hyväksyttävään käyttöön, samalla tavoin kuin eri perheiden ruokailua ohjaavat erilaiset säännöt: toisissa perheissä on hyväksyttävää käyttää kännykkää ruokapöydässä, toisissa ei. Jotkin yhteisöt hyväksyvät “tekoälytaiteen”, toiset haluavat todisteen siitä, että kuvat ovat lähtöisin kynästä eivätkä promptista.

Kirjoittaja on väitellyt sosiaalipsykologiasta tohtoriksi ja tutkii Aalto-yliopistossa Suomen Kulttuurirahaston apurahalla digitaalisten palveluiden käyttäjyyttä moraalisena identiteettinä.